しゃべってメモ帳アプリ

自分の備忘録です。前半は私の気持ち。後半はアプリの事。(2026.3.1)

現在でも、文章がおかしいので、笑ってください。元々、文章が下手ので、ごめんなさい。

1.序章

2023年12月9日午後まではクリニックを閉めたが、車を閉めても、左の半身の脱力で、救急車で入院した。ああ、これが脳梗塞だなと思って、そのときには、喋ることも出来ず、もう、検査はどこでどうなったのか分からない。翌日には、左の腕や脚の麻痺は良くなって、食事は自分で出来る。頭の中で思ってことは、しっかり、記憶はある。ただ、自分の文字が書けない、他人の喋ってる文章の簡単の事は分かる、けど、複雑の文章では分からない(2024年7月くらいに「言語聴覚士( ST )」という言葉が分かった。2025年1月くらいに、やっと「失語症」という言葉が分かった)。

入院の翌日には、自分のノートパソコンがあったのが、一番、助かった。ただ、キーボードで入力が駄目だった。

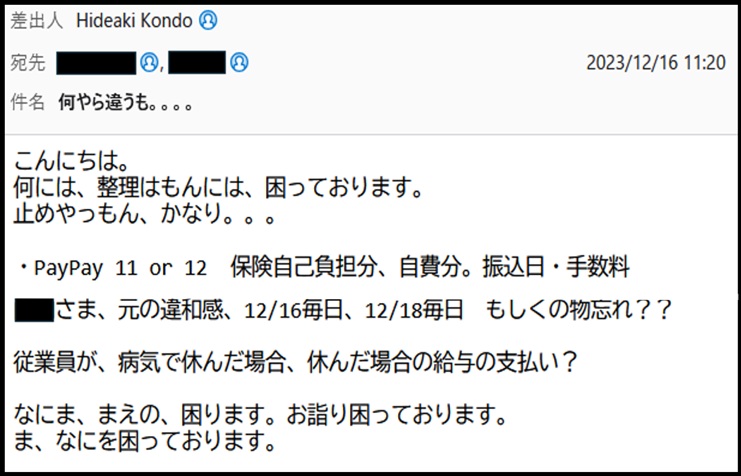

Fig. 入院 7病日 これで、前のメールの文章の、言葉をコピーandペースして、2時間かかった

その後、入院中にでは、病棟看護師さんやSTさんが喋ってる文章で1-2割しか分かっただけ。病室が移動する時、家族のお話、退院の時、ほぼ、何を喋ってて分からない。ただ、「ああ、これで自宅に帰れる、よかった。」だけ。結局、12月19日退院だった(これも後で分かったのは、私は入院拒否で退院だった。堪忍してね。)

電カルのリハビリも、ぼちぼち始めまして、2024年3月診察開始。電カルでは、キーワードや画面に見たらで、なんとか診察が出来ることになった。それでも、患者さんが喋ってる事や、カレンダーの日数が分かず、看護師さんのメモが無いと困った。

2024年4月17日には、車の運転中に、地震速報があっても、どこで地方が分からない、困った。その後、雑誌の内容が、ちんぷんかん分からない。映画の内容(それでも、日本語字幕や英語字幕のアシストがあって内容が分からない)。

2024年秋頃 STさんが作った失語症リハビリのアプリがある、と分かった。日常の事は、ホワイトボードが助かる。

2025年5月頃 雑誌の内容が、ほぼ、分かる。映画の内容(それでも、日本語字幕や英語字幕のアシストがあると内容が分かる)。「初めてのPython」「やさしいChatGPT」を買ったが、どう利用できるか、分からなかった。

2025年秋からは、ほぼ、難しい本の内容は理解が出来ることになった。

2026年元旦の雑誌を見て、これは、Python+ChatGPTで、診療に役立つかも思われ、看護師さんのメモが無くても、文字起こしが出来るかもと、思った。

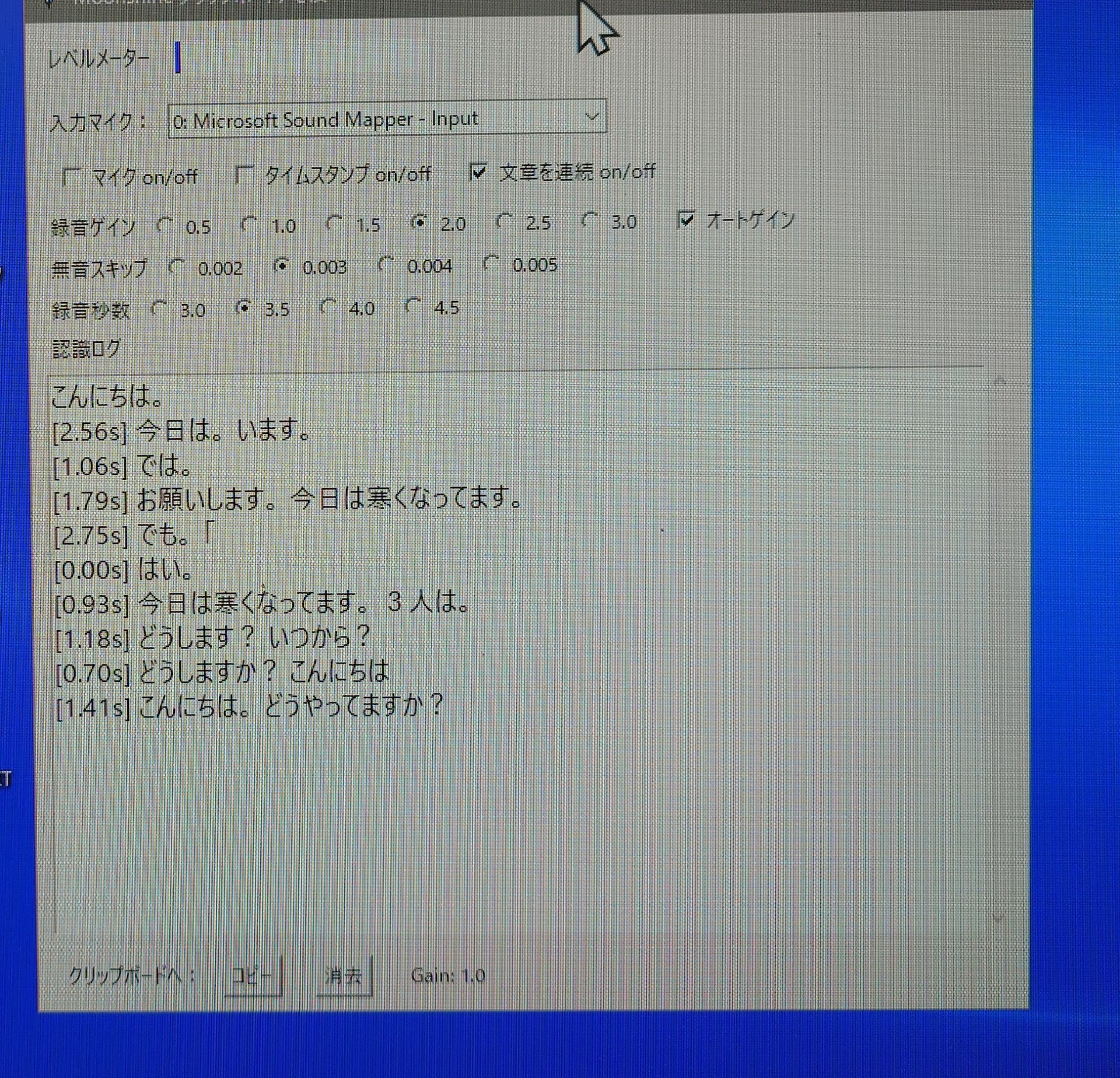

現在、Whisper、 MedSAR、kotoba(全部ASR:音声認識・Speech-To-Text)の日本語(英語はちょっと苦手)文章の構造(文章から語句や助詞まで)の再学問し、2026年2月26日 Moonshine Voiceを工夫してる。

2.プロンプト(順番で)

Moonshine Voiceっと言うのは知ってますか?

Whisper代替の超軽量STT/TTS、の事です

ローカルのパソコンで、日常会話にして、文字おきで、クリップボードを利用して、Pythonで作りたい。

新しいフォルダー「●●●」にして、簡単なアプリを作りたい。1️⃣ 本当にMoonshineで良いですね。

C:\Users\●●●>pip install moonshine-ai ERROR: Could not find a version that satisfies the requirement moonshine-ai (from versions: none) ERROR: No matching distribution found for moonshine-ai

1️⃣ 実験好きなのでMoonshineを無理やり触る(笑)

C:\Users\●●●\●●●>python test_moonshine.py Traceback (most recent call last): File "C:\Users\●●●\●●●\test_moonshine.py", line 2, in <module> from moonshine import MoonshineModel ModuleNotFoundError: No module named 'moonshine'

C:\Users\●●●>pip list

C:\Users\●●●\●●●>python test_moonshine.py Torch: 2.10.0+cpu moonshine_voice import OK

ネット「完全に正しい本家 Moonshine、 モバイル/エッジ向け ASR SDK」

1️⃣ 沼に入ってMoonshine SDKビルドまでやる、はいよ~

ネット「完全にネイティブSDK系プロジェクト」

ネット「Downloading Models The easiest way to get the model files is using the Python module. After installing it run the downloader like this: python -m moonshine_voice.download --language en 今入っている moonshine-voice が正しい公式パッケージ」 moonshine-voice = 公式Pythonラッパー、ほほー

python -m moonshine_voice.download --language ja

(中略)

Model download url: https://download.moonshine.ai/model/base-ja/quantized/base-ja Model components: ['encoder_model.ort', 'decoder_model_merged.ort', 'tokenizer.bin'] Model arch: 1 Downloaded model path: C:\Users\●●●\AppData\Local\moonshine_voice\moonshine_voice\Cache\download.moonshine.ai/model/base-ja/quantized/base-ja Moonshine日本語モデルがローカルに準備完了出来ましたね。

'transcriber'つまり、moonshine voice.transcriberが音声認識エンジン

ネット「モデルパス取得 import moonshine_voice model_path = moonshine_voice.get_model_path("ja") 」

モデルパス C:\Users\●●●\anaconda3\envs\●●●\lib\site-packages\moonshine_voice\assets\ja

import moonshine_voice

from moonshine_voice.transcriber import Transcriber

model_path, model_arch = moonshine_voice.get_model_for_language("ja")

model_path = str(model_path)

t = Transcriber(model_path, model_arch=model_arch)

🔥 Transcriber OK 。突破出来ましたね~(謎)Moonshine日本語Transcriber 起動成功

(中略)

>>> print(result) [0.51s] きょうは車を修理しました。 >>> ニヤリと(^^

✔ Windows

✔ CPU only

✔ ONNX

✔ C++コア

✔ 日本語モデル

✔ Pythonラッパー

✔ WAV → 文字起こし成功

3.Moonshineとは。。。

Whisperとは違う。Moonshineはadd_audio() → イベント駆動の設計。ストリーミング型、 Listenerで結果受け取る、get_transcript() は無い 。モノラル、 16000Hz、float 1次元配列、だって。

Moonshineは、超軽量、CPU最適化、ONNX実行、Whisperより起動速い

Moonshineは、Whisperより軽量、ONNXベース、Windowsでも動いた、日本語もOK

4.文章の文字起こし、へ

準備中。。。でも、患者さんが喋った文章がテキストに出来てますよ。

これで、一番、看護師さんの苦労が助かるかも。。